为什么你的 OpenClaw 应该跑在云上,而不是你的笔记本?

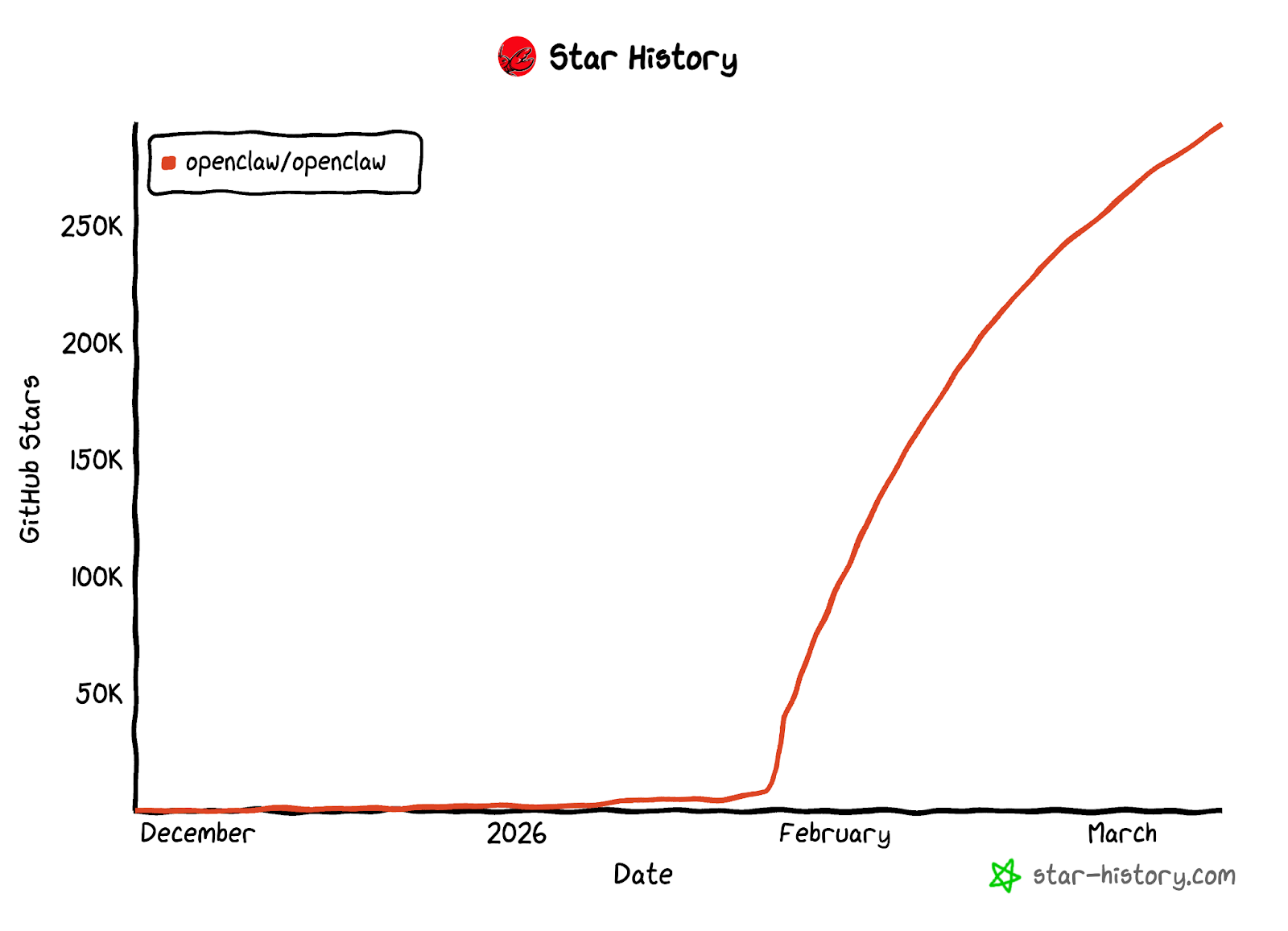

OpenClaw 已经在 GitHub 上获得超过 29 万 Star,成为 2026 年最受关注的开源 AI Agent 框架之一。越来越多的开发者和技术爱好者开始尝试在本地部署自己的 AI 助理。

然而,本地部署在实际使用中面临不少挑战:关机即断线、环境配置复杂、API Key 安全隐患等问题,严重限制了 AI Agent 的持续可用性。

将 OpenClaw 部署到云端,可以从根本上解决这些问题。本文将分析云端部署的核心优势,介绍如何选择合适的大语言模型,并展示 OpenClaw 在实际场景中的应用能力。

OpenClaw 简介

OpenClaw 是一个开源的个人 AI Agent 框架,使用 TypeScript 编写,具备以下核心能力:

- 7x24 自主运行:内置 Heartbeat 心跳机制,能够主动监控任务并自动执行,无需用户持续干预

- 50+ 平台集成:支持 WhatsApp、Telegram、Discord、Slack、Gmail、GitHub 等主流平台,实现跨平台统一管理

- 模型灵活性:兼容 Claude、GPT、Grok 等云端大模型,同时支持通过 Ollama / vLLM 运行本地模型

- 可扩展技能系统:采用 Markdown + YAML 定义技能,ClawHub 上已有 100+ 预制技能可直接使用

- 隐私优先设计:所有数据默认存储在用户本地,记忆系统基于本地 Markdown 文件

与传统聊天机器人不同,OpenClaw 具备上下文记忆、主动行为能力和工具调用能力,更接近一个能够持续工作的 AI 协作者。

云端部署 vs 本地部署

虽然 OpenClaw 支持在本地运行,但对于追求稳定性和持续可用性的用户而言,云端部署具有明显优势。

本地部署适合短期测试和体验,而云端部署才能真正释放 AI Agent 的持续服务能力。一个需要随时待命的 AI 助理,首先需要一个永远在线的运行环境。

部署成本

运行 OpenClaw 本身不需要 GPU 资源,一台基础 CPU 虚拟机实例(2 核 / 4GB 内存 / 20GB SSD)即可稳定运行。以该配置为例,Bitdeer AI Cloud 的按需费用约为 $0.0363/小时(约 $26/月),即可获得一个 7x24 在线的 AI 助理运行环境。

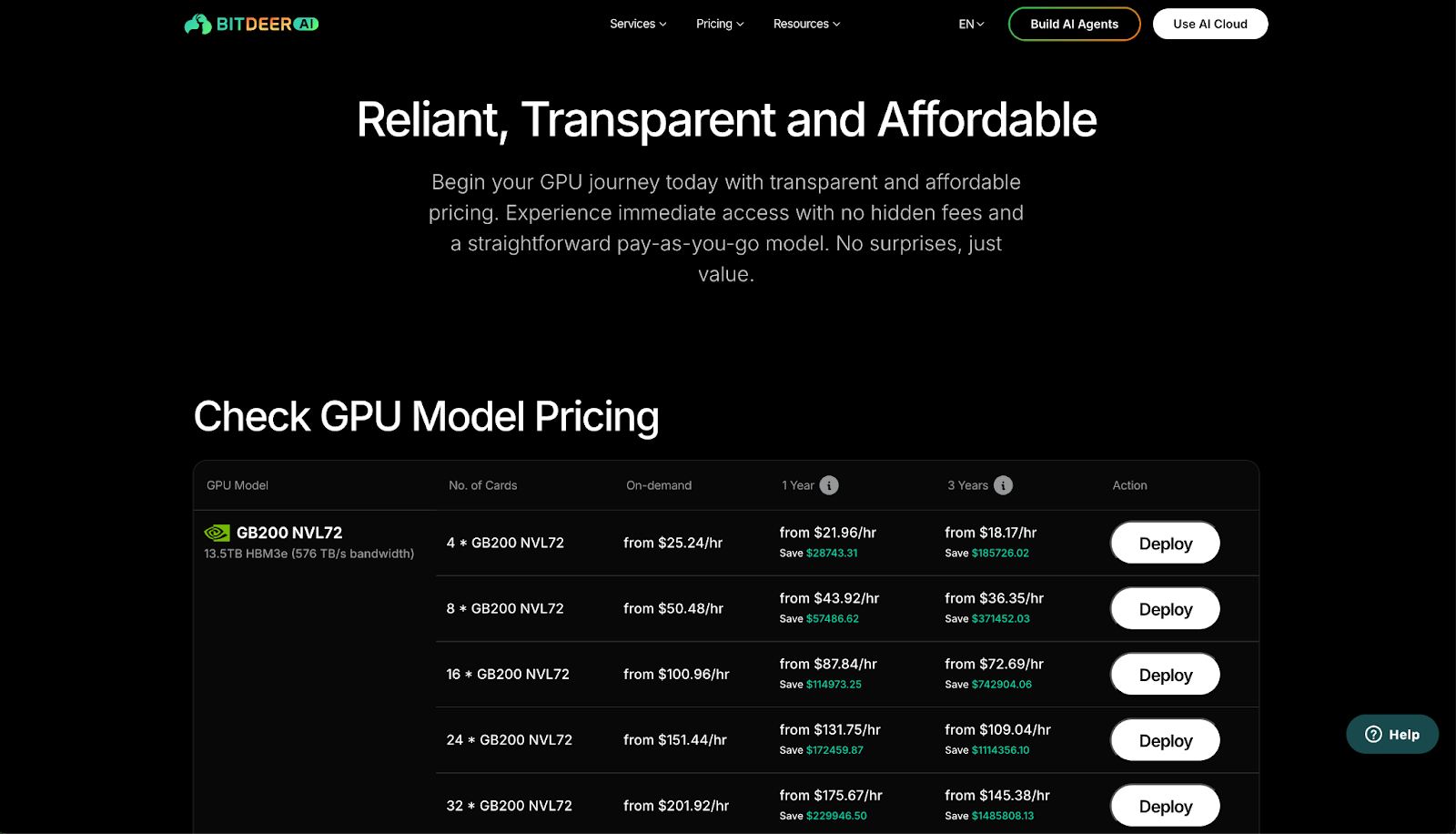

Bitdeer AI Cloud 作为 NVIDIA 首选云合作伙伴(Preferred Cloud Service Provider),提供覆盖 H100、H200、B200、GB200 等多代 NVIDIA GPU 的算力资源。对于 OpenClaw 这类 Agent 部署场景,CPU 实例即可满足运行需求;如有模型微调或本地推理等进阶需求,也可灵活升级至 GPU 实例。虚拟机实例按需计费,详情请参考 GPU Compute 定价页。

模型推理部分通过 API 调用完成,按 Token 计费。Bitdeer AI Cloud 提供多厂商的模型推理服务,涵盖文本生成等多种任务类型。详细的模型推理定价请参考 AI Models 定价页。

模型选择指南

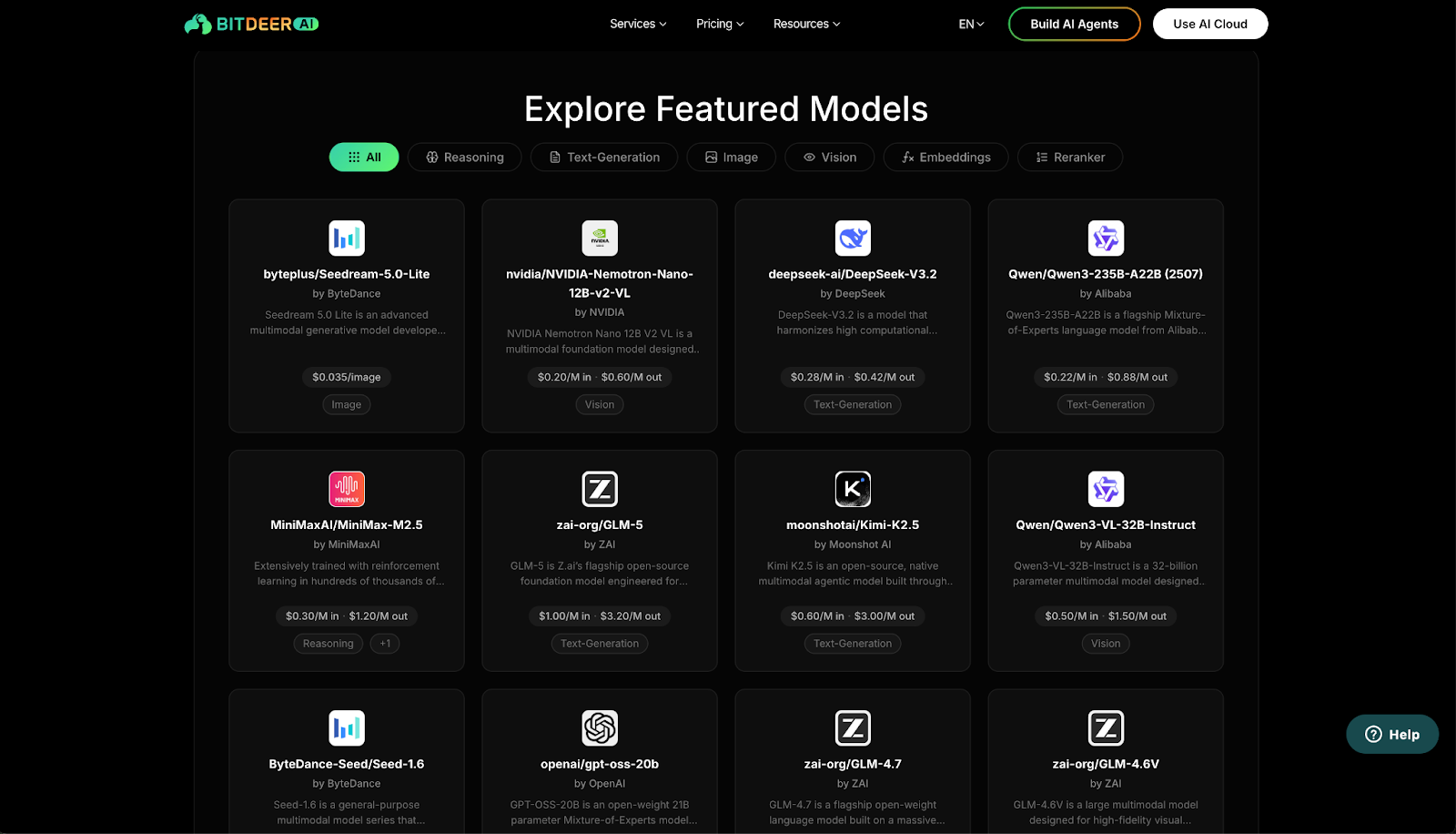

OpenClaw 的核心优势之一是模型灵活性——不绑定任何单一 LLM 厂商。Bitdeer AI Cloud 目前提供来自 10+ 厂商的 40+ 模型,涵盖文本生成、视觉理解、推理、文生图等多种任务类型,API 兼容 OpenAI 标准,模型切换成本接近于零。

以下为适用于 OpenClaw 的代表性文本生成模型及定价参考:

场景化选择建议

- 综合性价比首选 — DeepSeek-V3.2,输入输出综合成本最低,代码和推理能力业界领先

- 长文本输入场景(如文档分析、邮件摘要)— Qwen3-235B-A22B,输入单价仅 $0.22/百万 Token

- 中文深度对话 — Kimi-K2.5,中文理解能力优秀,适合需要高质量中文输出的场景

- 极致低成本 — 平台同时提供 Gemma、Ministral 等轻量模型,输入低至 $0.02/百万 Token,适合高频低复杂度任务

完整模型列表和在线体验请访问 Bitdeer AI Model Explore。

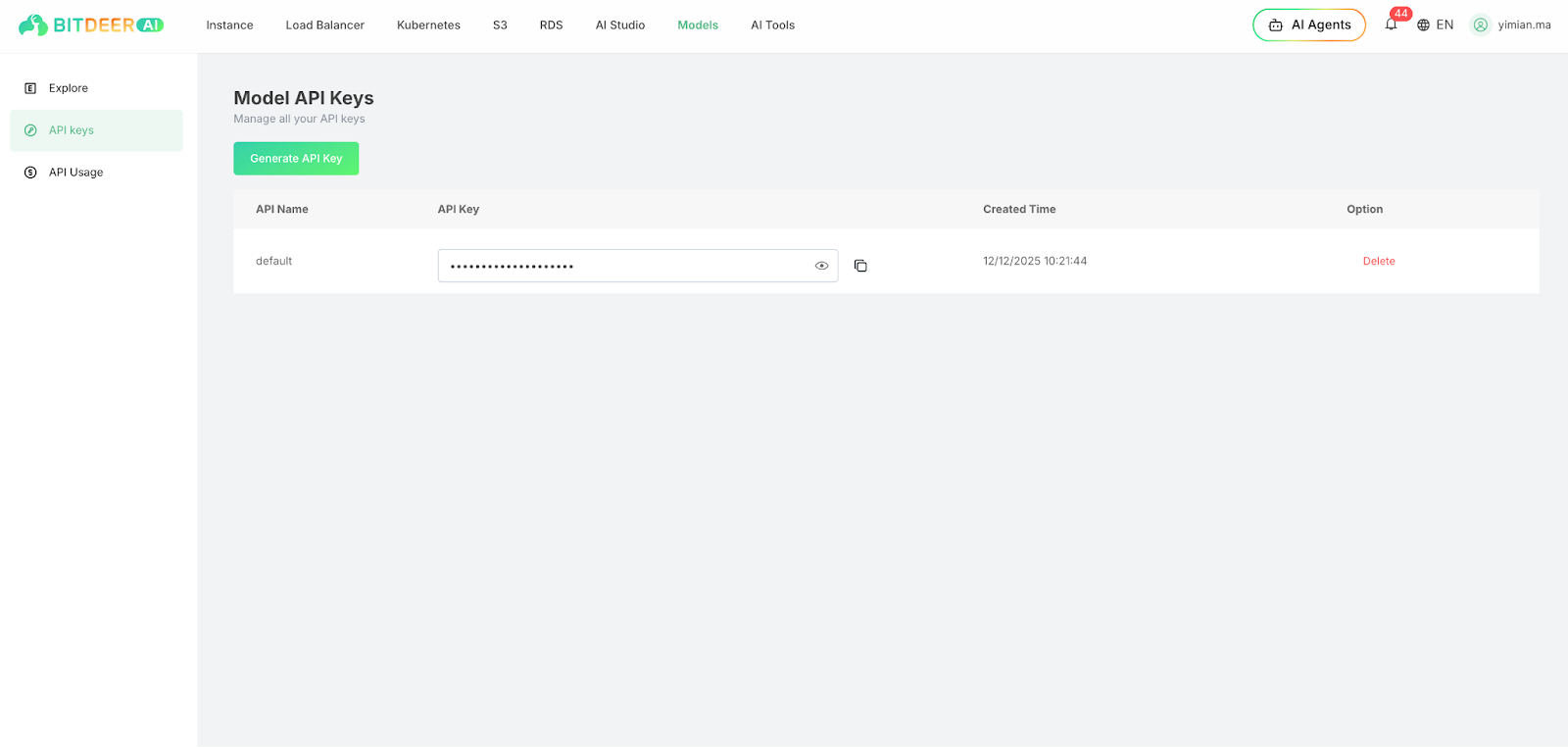

OpenClaw 通过配置文件即可完成与 Bitdeer AI 模型服务的对接——用户只需在 openclaw.json 中填入 API Key 和模型名称,OpenClaw 会自动处理所有 API 通信,无需编写任何调用代码。所有 Bitdeer AI 模型 API 兼容 OpenAI REST 标准,因此 OpenClaw 可以直接识别和调用。

API Key 可在 Bitdeer AI Cloud 控制台的 API Keys 页面生成。

部署流程

Bitdeer 官方已提供完整的部署教程,涵盖从创建云实例、安装 OpenClaw、配置模型连接到对接 Telegram 的全部步骤。详细操作指南请参考:

Installing and Configuring OpenClaw on Bitdeer AI Cloud

整个部署流程可概括为五个步骤:

- 创建云实例 — 在 Bitdeer AI Cloud 上开通虚拟机实例

- 安装 OpenClaw — 通过官方脚本一键完成安装

- 配置模型 — 填入 Bitdeer API Key,指定 LLM 模型

- 对接 Telegram — 完成 Bot 配对,实现移动端访问

- 后台运行 — 服务自动在后台 7x24 持续运行

实际应用场景

部署完成后,OpenClaw 能够在多个维度发挥实际价值。以下列举几类典型使用场景:

个人效率管理

- 连接 Gmail 自动阅读邮件,提取待办事项,每日定时发送摘要

- 通过 Google Calendar 集成,直接在对话中创建和管理日程

- 实时多语言翻译,支持中、英、日、韩等语言互转

信息研究与分析

- 执行网络搜索,阅读网页内容,生成结构化摘要

- 对指定 URL 进行内容提取和要点总结

- 多步骤信息收集与对比分析,输出结构化报告

代码生成与执行

- 在沙箱环境中生成并执行代码,直接返回运行结果

- 支持 Python、JavaScript 等主流语言,适用于数据处理、脚本编写等场景

- 可结合网络搜索能力,自动查阅文档并生成可运行的代码方案

以上能力依托 OpenClaw 的技能系统实现。ClawHub 上已有超过 100 个预制技能可直接安装使用。如需开发自定义技能,可参考 OpenClaw Skills 官方文档。

总结

OpenClaw 作为一个功能完备的开源 AI Agent 框架,结合 Bitdeer AI Cloud 的云端基础设施和模型推理服务,能够为用户提供一个稳定、安全、持续在线的 AI 助理解决方案。

开始使用

注:以上提及的模型及 GPU 价格仅供参考,具体请以平台实时价格为准。